Titre provocateur puisque, je le reconnais et l’affiche sur mon site, je m’oppose à la publication des fruits d’une I.A en littérature ou dans l’illustration. Au-delà des problèmes de droits d’auteurs et environnementaux, publier un livre rédigé par un I.A et oser le signer, non seulement c’est mensonger, mais c’est aussi une forme de mépris affiché vis à vis du lecteur qui pense acheter une œuvre d’un « auteur » (j’hésite à utiliser ce terme) et qui en vérité achète un texte compilé des écrits de vrais écrivains. idem, en ce qui concerne les illustrations de couverture ou intérieur. Et quand je parle de mépris, c’est aussi vis à vis des véritables auteurs, ceux qui ne font pas appel aux I.A, ceux qui usent de leur talent, de leur vécu, de leur sensibilité… pour écrire une œuvre originale. Bref, publier un livre rédigé par une I.A c’est tirer la notion même de littérature vers le bas.

Maintenant que j’ai dit cela, pour autant je m’interroge…

Autour de moi, l’usage des I.A progresse à une vitesse impressionnante. J’ai connaissance d’entreprises qui font de la vente, de la diffusion, de la formation et de l’usage des I.A une priorité… Alors donc, effectivement, je m’interroge. Luter contre une les I.A n’est-ce pas peine perdue ? N’il y a-t-il pas mieux à faire ?

IA : Vers un nouveau contrat social ?

L’intelligence artificielle n’est plus une promesse de science-fiction, mais une réalité qui transforme déjà notre quotidien. Pour répondre aux défis posés par cette révolution, plutôt que de s’allonger sur les rails en espérant arrêter un train lancé à pleine vitesse, ne vaut-il pas mieux monter dedans et tenter par l’intérieur de modeler l’outil pour qu’il soit une possibilité de « progrès » et non de destruction ?

Je pense que les I.A en soit ne sont pas le problème. Ce n’est qu’un outil qui bien utilisé pourrait avoir une véritable utilité. Ne vaudrait-il pas mieux chercher des solutions pour répondre aux enjeux de respect des droits et d’environnement que soulève l’usage de l’outil plutôt que de luter contre l’outil lui-même ? La difficulté n’est pas l’outil, mais son impact et son usage actuellement anarchique, faute de cadre, de lois, de règles…

Bref, finalement ce qui manque ne serait-ce pas des textes qui tenteraient de concilier l’innovation technologique avec le respect des créateurs, de la planète et des citoyens ?

Protéger les créateurs face aux algorithmes

Jusqu’ici, de nombreux modèles d’IA se sont entraînés sur des images, des textes et des musiques sans toujours citer ni rémunérer les auteurs. Une loi pourrait changer la donne en imposant par exemple :

- Aux concepteurs des I.A de lister les types d’œuvres utilisées pour entraîner leurs modèles et afficher ces sources systématiquement.

- Le droit pour les auteurs, les vrais, de refuser que leurs œuvres servent à nourrir les futures IA.

- Une contribution financière prélevée auprès des exploitants d’IA pour rémunérer les artistes via un système de gestion collective (sur le model de la Sacem ?).

L’IA sous surveillance écologique

On oublie souvent que l’IA consomme énormément d’énergie et d’eau (pour refroidir les serveurs), c’est pourtant un élément fondamental. Je connais des entreprises qui s’enorgueillissent d’afficher un bilan carbone à zéro, mais n’intègrent pas dans ce bilan l’impact écologique de l’usage massif des I.A… La aussi une loi devrait imposer :

- Aux grandes entreprises d’IA de publier leur consommation énergétique et leurs émissions de gaz à effet de serre.

- Aux entreprises utilisant les I.A d’intégrer cet usage dans le calcul de leur bilan.

- Qu’une contribution environnementale soit calculée selon l’empreinte carbone de chaque modèle.

Je sais que l’on va me dire que cela pourrait être un frein au développement économique des entreprises, mais c’est un choix responsable avant tout. Et un tel bilan vertueux pourrait aussi attirer des clients et au final être un argument pour les entreprises.

En parallèle, la mise en place d’une politique visant à développer des technologies moins polluantes devrait être une priorité.

Transparence et vérité pour le citoyen

Pour éviter la désinformation, une loi pourrait imposer une clarté absolue sur l’origine des contenus, en imposant par exemple :

- Que tout contenu (image, texte, vidéo…) généré par une IA soit clairement identifié comme tel lors de sa diffusion.

- Que les systèmes les plus puissants ou les plus influents (les médias, les réseaux sociaux…) soient régulièrement contrôlés par des organismes tiers et indépendants pour s’assurer qu’ils ne présentent pas de dérives.

- Que des sanctions dissuasives soient mises en place pour tous contrevenants.

L’humain d’abord : emploi et responsabilité

L’IA doit être un outil au service de l’homme, et non l’inverse – C’est un principe qui devrait être régulièrement rappelé. En cas de problème ou de décision erronée d’une IA, la responsabilité devrait incomber à ceux qui l’ont conçue ou diffusée, et non à l’outil. Et les entreprises créatrices d’IA ne devraient-elles pas financer des plans de formation et de reconversion pour accompagner les métiers transformés par ces technologies.

Mais finalement ?

Bref, je pense qu’avec une véritable volonté politique, l’usage des IA pourrait cesser de poser problème. Mais finalement, tout ceci n’est-ce pas qu’un vœu pieux ? À la vitesse où se développe l’usage de l’outil et au regard des impacts nombreux et négatifs de cet usage, sa réglementation devrait être une priorité pour les gouvernements. Le moins que l’on puisse dire est que, malheureusement, cela ne semble pas à l’ordre du jour… Il est peut-être le là le vrai problème ? Le manque de volonté politique…

Alors auteurs, illustrateurs — j’entends par là ceux qui usent de leur talent pour proposer des œuvres uniques —, continuez à afficher votre refus des œuvres générées par I.A et vendues sous le nom d’un auteur qui n’a rien fait. Vos qualités uniques font la différence avec ce que proposent les I.A.

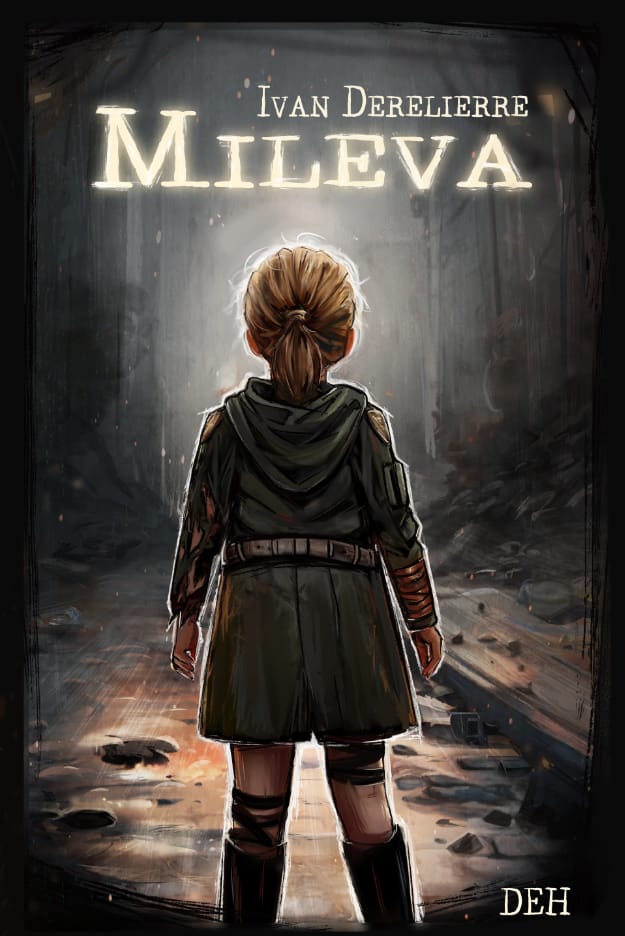

L’avenir de nos relations, nous humains, avec des I.A est au coeur de mon roman Mileva